Funcionários da Microsoft e Google alertam sobre chatbots

Na corrida dos chatbots, gigantes da tecnologia escolheram velocidade ao invés de cautela, revelam funcionários e documentos internos

Dois funcionários do Google, cujo trabalho é revisar produtos de IA (inteligência artificial), tentaram impedir, em março de 2023, que a empresa lançasse um chatbot estilo ChatGPT. Dez meses antes, especialistas em ética e outros funcionários também tentaram segurar um lançamento parecido na Microsoft. Mas não adiantou.

No caso dos funcionários do Google, eles acreditavam que o chatbot gerava declarações imprecisas e perigosas nos testes. Já os da Microsoft escreveram, em vários documentos, que a tecnologia por trás de um chatbot poderia inundar grupos do Facebook com desinformação, degradar pensamento crítico e corroer a base factual da sociedade moderna.

Lançamentos desenfreados de chatbots

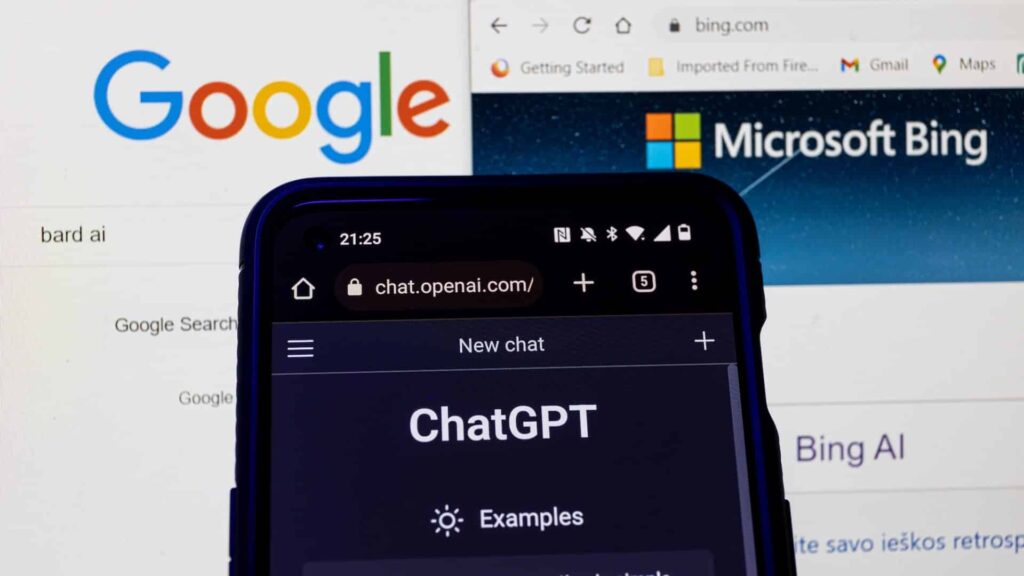

Sucesso do ChatGPT levou Microsoft e Google a assumirem riscos maiores com suas diretrizes éticas (Imagem: Victor Habbick Visions/Science Photo Library/Getty Images/Google/Microsoft)

Chatbots da Microsoft e do Google aparecem no mesmo ano, com semanas de diferença e poucos meses após o boom do ChatGPT, da OpenAI (startup que trabalha com a empresa de Bill Gates atualmente), mostra que existe uma corrida em curso. Na linha de chegada, está o controle do que poderia ser a próxima grande novidade da indústria de tecnologia: IA generativa, a nova tecnologia que alimenta esses chatbots.

O sucesso do ChatGPT – que agora tem cerca de 100 milhões de usuários mensais – levou Microsoft e Google a assumirem riscos maiores com suas diretrizes éticas estabelecidas ao longo dos anos. Diretrizes essas pensadas para garantir que sua tecnologia não cause problemas sociais. Tudo isso de acordo com 15 funcionários, ex-funcionários e documentos internos das empresas.

Recentemente, a tensão entre preocupados do setor e os que assumem riscos tomou proporções públicas, quando mais de mil pesquisadores e líderes do setor, incluindo Elon Musk e o cofundador da Apple, Steve Wozniak, pediram uma pausa de seis meses no desenvolvimento de tecnologia baseada em IA. Numa carta pública, eles disseram que apresentava “profundos riscos para a sociedade e a humanidade”.